1717899190

2024-06-07 16:09:02

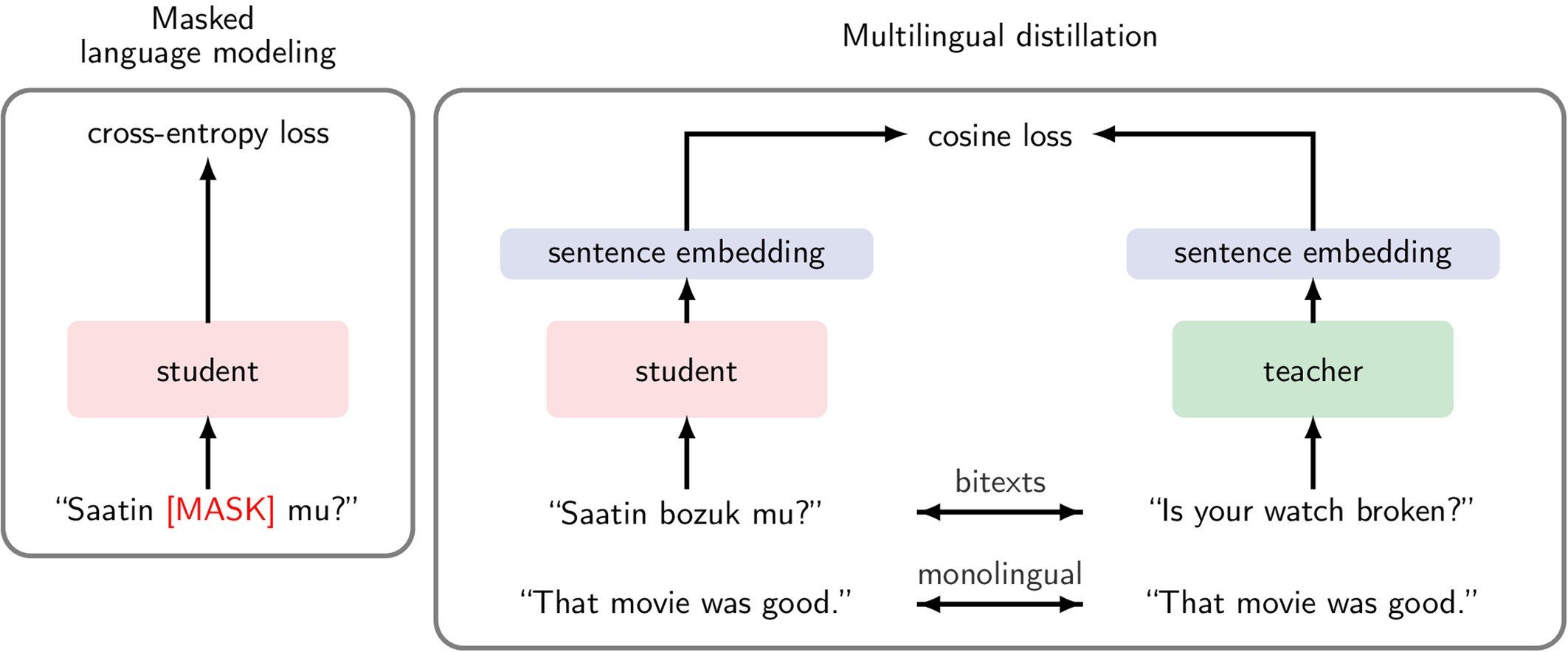

LASER3 教師と生徒のアプローチのアーキテクチャ。クレジット: 自然 (2024年)。DOI: 10.1038/s41586-024-07335-x

200の異なる言語を翻訳できるMetaの人工知能モデルの背後にある技術は、論文で説明されている。 出版された で 自然このモデルにより、機械翻訳で翻訳できる言語の数が増えます。

ニューラル機械翻訳モデルは 人工ニューラルネットワーク 言語を翻訳します。これらのモデルは通常、トレーニングに大量のオンラインでアクセス可能なデータを必要としますが、一部の言語 (「低リソース言語」と呼ばれる) では、公開されておらず、安価でもなく、一般的に入手できない場合があります。翻訳する言語の数という点でモデルの言語出力を増やすと、モデルの翻訳の品質に悪影響を与える可能性があります。

マルタ・コスタ・ジュサとノー・ランゲージ・レフト・ビハインド(NLLB)チームは、神経言語の 機械翻訳 モデルは、既存の高リソース言語の翻訳能力を利用して、低リソース言語の翻訳方法を学習します。

その結果、研究者たちはオンライン多言語 翻訳 NLLB-200 と呼ばれるツールには 200 の言語が含まれており、高リソース言語の 3 倍の低リソース言語が含まれており、既存のシステムよりも 44% 優れたパフォーマンスを発揮します。

研究者らは、リソースの少ない多くの言語のサンプルを 1,000 ~ 2,000 個しか入手できなかったため、NLLB-200 のトレーニング データ量を増やすために、言語識別システムを利用して、特定の方言のインスタンスをさらに識別しました。また、研究チームはインターネット アーカイブからバイリンガル テキスト データもマイニングし、NLLB-200 が提供する翻訳の品質向上に役立てました。

著者らは、このツールは、翻訳がほとんど行われていない言語を話す人々がインターネットやその他の技術にアクセスするのに役立つ可能性があると指摘している。さらに、このモデルはリソースの少ない言語を話す人々がより多くの本や情報にアクセスできるようにするため、教育への応用が特に重要であると強調している。 研究論文しかし、コスタ・ジュサ氏と共著者らは、誤訳が依然として発生する可能性があることを認めている。

詳しくは:

ニューラル機械翻訳を200言語に拡張、 自然 (2024年)。 DOI: 10.1038/s41586-024-07335-x

によって提供された

ネイチャー出版グループ

引用: Meta の AI はリソース不足の数十の言語を翻訳できる (2024 年 6 月 7 日) 2024 年 6 月 8 日に https://techxplore.com/news/2024-06-meta-ai-dozens-resourced-languages.html から取得

この文書は著作権の対象です。個人的な学習や研究を目的とした公正な取り扱いを除き、書面による許可なしに複製することはできません。コンテンツは情報提供のみを目的として提供されています。

#MetaのAIはリソース不足の言語を数十言語翻訳できる