1716070693

2024-05-17 18:41:21

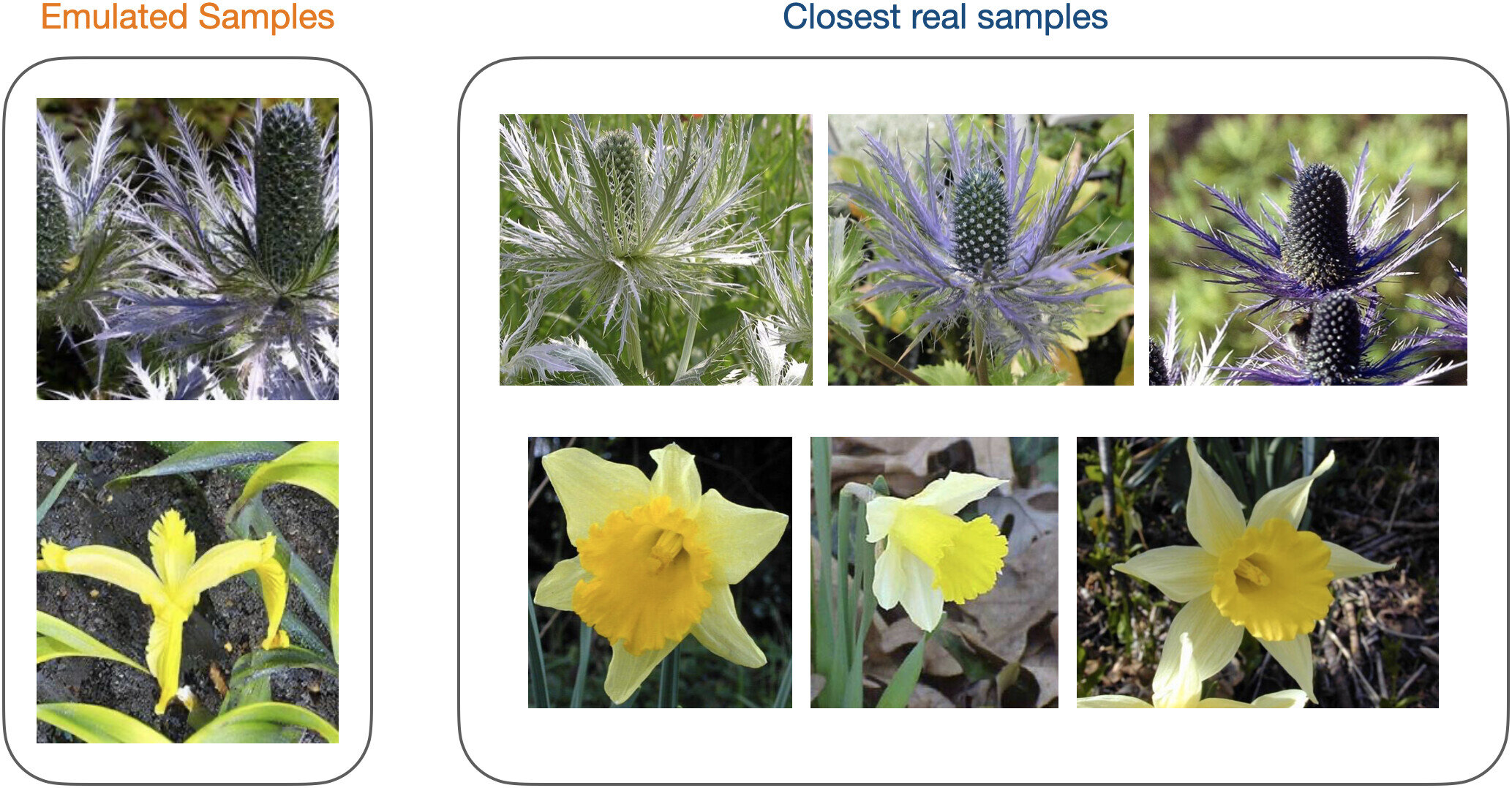

データセットエミュレーションの例。 元のデータからの高い CLIP 距離を維持しながら元の分布をキャプチャする、オックスフォード フラワーのエミュレートされたデータセットのサンプルを示します。 クレジット: 米国科学アカデミーの議事録 (2024年)。 DOI: 10.1073/pnas.2307304121

今では、生成 AI によってもたらされる課題は周知の事実です。 OpenAI の ChatGPT、Anthropic の Claude、Meta の Llama などのモデルは、「幻覚」を起こし、誤解を招く可能性のある応答をでっち上げたり、著作権で保護された資料などの機密情報を漏洩したりすることが知られています。

これらの問題のいくつかに対する潜在的な解決策の 1 つは、「モデル デゴルジュマン」です。これは、著作権侵害や偏った応答につながるコンテンツをモデル自身に強制的に削除する一連のテクニックです。

で 紙 で 米国科学アカデミーの議事録、コンピュータおよび情報科学 (CIS) の管理と技術の国立センター教授である Michael Kearns と Amazon の 3 人の研究員が、今日 AI モデルが直面している問題のいくつかを解決するためのモデルのデゴルジュマンの可能性についての見解を共有しています。

次の Q&A で、カーンズ氏はこの論文と AI の改善に対するその影響について説明します。

モデルのデゴルジュマンとは何ですか?

モデル デゴルジュマンは、幅広いテクニックと、それらのテクニックが解決しようとしている問題の名前です。 目標は、トレーニングされたモデルの動作からトレーニング データの特定の部分の影響を軽減または根絶することです。

トレーニング データの個々の部分またはトレーニング データのコレクションがモデルの動作に影響を与えることが期待されます。 しかし、これはプライバシーの漏洩、著作権侵害、その他まだ法律でカバーされていない問題につながる可能性があります。

モデルのデゴルジュマンは、ヨーロッパの一般データ保護規則のようなデータプライバシーを確保する取り組みとどう違うのですか?

これらは異なるものですが、関連する懸念事項です。 私が Facebook に、保存されている Facebook アクティビティをすべてサーバーから削除するよう依頼した場合、GDPR では要求に応じて削除することが求められています。

GDPR などの法律では、データが削除される前に何が起こるかについてはあまり明確ではありません。 あなたのデータは予測モデルのトレーニングに使用され、その予測モデルは今も存在し、世界中で稼働しています。 Facebook のサーバーからデータが削除された後でも、そのモデルは依然としてデータに基づいてトレーニングされたままになります。 これにより、さまざまな問題が発生する可能性があります。

1 つ目は、データが非公開の場合、サードパーティの攻撃者が個人データの機密部分をリバース エンジニアリングできる可能性があります。 これは確かに、モデルのデゴルジュメント技術を使用して機密データをモデルから削除する必要がある例です。

さらに、ニューヨーク・タイムズによる OpenAI に対する訴訟で見られるように、著作権の問題もあります。 ChatGPT は、タイムズ紙の著作権で保護された記事をそのまま逆流することができます。 OpenAI が ChatGPT のトレーニングにこれらの記事を使用したことは明らかです。

はっきり言っておきますが、同紙はこれらの記事を非公開にすることを望んでいません。 記事を一般の人がアクセスできるようにしたいと考えています。 しかし、タイムズ紙は記事の使用と複製も管理したいと考えている。

最後に、「文体侵害」と呼ぶべき別の問題があります。ユーザーは、「リッテンハウス スクエアでスケートボードをしている猫をアンディ ウォーホル風に描いた絵をください」と言うことができます。 このモデルは、アンディ ウォーホルのキャリア全体に基づいてトレーニングされているため、優れた仕事をすることができます。 あなたがアンディ・ウォーホルの遺産管理者であれば、これに異議を唱えるかもしれません。

これらはまったく異なる問題ですが、それらに対処する技術的な方法は非常に似ており、モデルのデゴルジュマン技術が含まれます。 言い換えれば、モデルのデゴルジュマンと安全性を確保する取り組みが異なるというわけではありません。 データのプライバシーモデルのデゴルジュメント技術は、GDPR などのプライバシーに対する現在のアプローチでは不十分な特定の状況で使用できるということよりも重要です。

CIS のコンピュータおよび認知科学のヘンリー サルバトリ教授であるアーロン ロスとの共著で、最近 AI の文脈で参照した『倫理的アルゴリズム』では、アルゴリズム設計に倫理的考慮事項を組み込む方法が説明されています。 そのアプローチは AI モデルでも実現可能でしょうか?

私たちがこの本を書いたとき、少なくとも今日のように生成 AI は存在していませんでした。 私たちの本は従来の機械学習に焦点を当てていました。これには、ローン申請に関する情報を取得し、特定の人がローンを与えられた場合に債務不履行になるリスクを評価するなど、より的を絞った予測が含まれます。

アプリケーションがそのようにターゲットにされている場合、モデルのパフォーマンスにおける人口統計上の偏りやプライベート トレーニング データの漏洩など、懸念されるさまざまな害に対する防御策をトレーニング プロセスに組み込むことがより現実的になります。

今のところ、生成モデルの出力が極端に無制限であるため、生成モデルをトレーニングする能力は失われています。

AI モデルのトレーニング データをフィルタリングして、偏った応答や著作権侵害の応答の可能性を減らすことは可能でしょうか?

それはいくつかの理由から難しいです。

競争力のある大規模言語モデルをトレーニングする方法は、文字通りインターネット全体をスクレイピングすることです。 それが賭け金です。 他にも独自のデータ ソースが多数必要になります。 それが出発点となると、トレーニング データについて知らないことがたくさんあります。

原則として、私たちはこれらすべての問題を回避する方法で巨大なニューラル ネットワークをトレーニングする方法を知っています。 次の制約の下でニューラル ネットワークをトレーニングできます。 差分プライバシー、個人情報を保護するためにデータを意図的に破損する方法など、このような問題は発生することが少なくなります。

誰も試していません。 一般的な感覚としては、差分プライバシーの制約の下で大規模な言語モデルをトレーニングすることによって得られるパフォーマンスの低下は、そもそもの意味を台無しにするものであると思います。

言い換えれば、品質が非常に悪いため、意味のない、文法的でない出力が生成されることになります。 トレーニング プロセスに追加する必要があるノイズの量 (差分プライバシーの仕組み) は、大規模には機能しません。

モデルのデゴルジュマン手法の例をいくつか挙げていただけますか? それらはどのように機能するのでしょうか?

概念的に単純な解決策の 1 つは、最初から再トレーニングすることです。 これらのネットワークの規模とサイズ、およびネットワークのトレーニングに必要な計算時間とリソースを考慮すると、これは明らかに実行不可能です。 同時に、再トレーニングは一種のゴールドスタンダードであり、より効率的でスケーラブルな方法で達成したいものです。

次に、「アルゴリズム」ソリューションがあります。 その 1 つは、機械の「非学習」です。 ネットワーク全体を再トレーニングする代わりに、トレーニング プロセスに対するデータの影響を軽減または軽減する何らかの方法でネットワークを変更するだけで済みます。

もう 1 つのアルゴリズム アプローチは、差分プライバシーの制約の下でトレーニングすることです。つまり、データ セットの集合的なプロパティを引き続き使用しながら、トレーニング データの特定の部分の影響を最小限に抑える方法でトレーニング プロセスにノイズを追加します。

次に、システムレベルのテクニックと呼ぶべきものがあります。 その1つが「シャーディング」です。 トレーニング データを 100 個の「シャード」に分割した場合、それらの 100 個のシャードごとに異なるモデルをトレーニングし、それらの 100 個のモデルを平均して全体のモデルを生成できます。

幸運なことに、データが 100 シャードの 1 つにのみ存在し、データを削除したい場合は、そのモデルを平均から完全に削除するだけで済みます。 あるいは、データ全体の 1% のみを使用して、そのモデルだけを再トレーニングすることもできます。

ChatGPT などに対するデータの貢献は非常にわずかです。 シャーディング手法を実行した場合、データはおそらく、これら 100 個のシャードのうちの 1 つ、多くても 2 つに完全に収まることになります。

より大きな懸念は、本当に大規模なデータセットです。 使用しているすべての組織のデータが 100 シャードの 1 つにのみ存在することを確認するにはどうすればよいでしょうか?

これを調整するには、組織が何であるかを事前に知っておく必要があります。これは、トレーニング データに何が含まれているかがわからないことが多いという以前の点に戻ります。

私のトレーニング データが、インターネット全体をクロールしたような巨大なファイルであり、それを 100 個の部分に分割した場合、ゲッティ イメージズのデータがその 100 個の部分のどこに分散されるかわかりません。

過去に戻ってインターネットの設計方法を変えることができたら、オンラインのすべてのデータにタグ付けするか、さまざまなレベルの保護で識別できるようにして、インターネットをスクレイピングすることで AI モデルが何を実行できるかを知らせるメタデータを生成できるようにすることはできるでしょうか。トレーニングでは使えないの?

私の直感的な反応は、このアプローチはここで議論している問題の解決には役立つかもしれないが、他の場所ではまったく異なる問題を引き起こす可能性があるということです。

消費者向けインターネットの大きな成功の 1 つは、そのオープン性と、データの編成方法やデータが他のデータを相互参照できる方法に関する構造とルールの欠如でした。 ルールを別の方法で設定することも考えられます。 しかし、インターネットを構築するのは面倒すぎるため、インターネットが実現しない可能性があることも想像できます。

インターネットの大成功は、基本的にルールの欠如から生まれました。 今日私たちがここで議論している分野では、ルールの欠如の代償を払わされています。

プライバシーとセキュリティについて真剣に考えているほとんどの人は、これらのテーマにおける最大の問題の多くはルールの欠如やインターネットの設計に起因するということにおそらく同意するでしょう。しかし、それがインターネットを非常にアクセスしやすく成功させた理由でもあります。

要するに、これらのトレードオフを回避するのは困難です。

最近の論文では、あなたと共著者は、上で説明したモデルのデゴルジュメント手法を分類法にまとめ、アクションを実行する時期とその仕組みに従って分類しています。 この論文が将来の研究者や業界専門家に何を提供することを期待しますか?

これは多くの点で非技術的な論文であり、より幅広い読者を対象としています。 この論文がこれらの問題、特にモデルのデゴルジュマンにおけるさまざまな技術的手法間のトレードオフについての考え方を組み立てるのに役立つことを願っています。 これは社会的に十分に重要であり、科学的にも十分に初期段階にあるトピックであるように感じられたので、一歩進んで状況を調査する良い機会だと感じました。

詳しくは:

Alessandro Achille 他、AI モデルのデゴルジュメント: 方法と選択、 米国科学アカデミーの議事録 (2024年)。 DOI: 10.1073/pnas.2307304121

によって提供された

ペンシルバニア大学

引用: Q&A: モデルのデゴルジュマン — AI バイアスと著作権侵害を修正する鍵? (2024 年 5 月 17 日) https://techxplore.com/news/2024-05-qa-disgorgement-key-ai-bias.html より 2024 年 5 月 18 日に取得

この文書は著作権の対象です。 個人的な研究や研究を目的とした公正な取引を除き、書面による許可なしにいかなる部分も複製することはできません。 コンテンツは情報提供のみを目的として提供されています。

#モデルのデゴルジュマン #の偏見と著作権侵害を修正する鍵