1707573985

2024-02-09 18:26:03

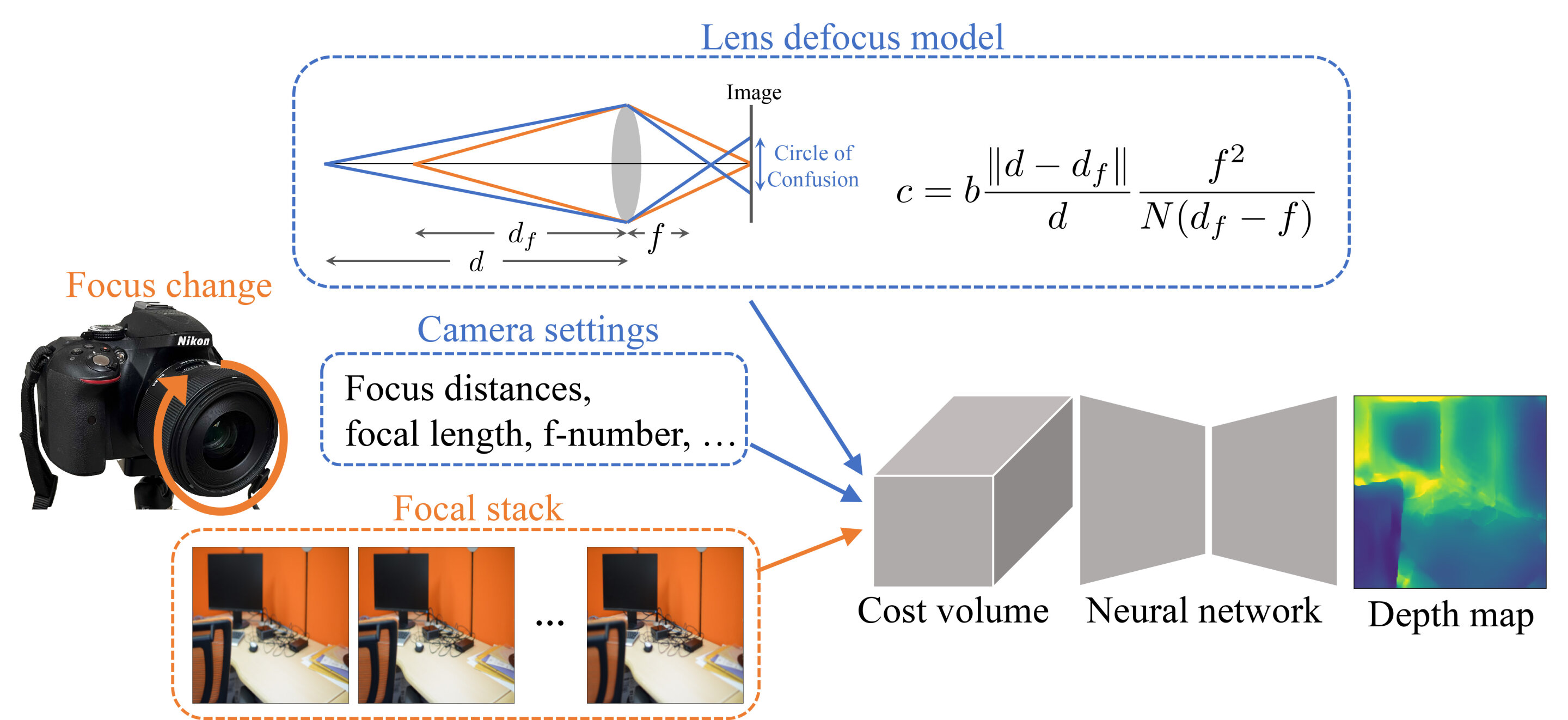

提案された方法は、焦点スタックとカメラの設定を入力として受け取り、レンズの焦点ぼけモデルに基づいてコスト量を確立します。 この設計により、トレーニング時とテスト時にさまざまなカメラ設定で深度推定が可能になります。 クレジット: 藤村有紀

拡張現実や自動運転車など、コンピューター ビジョンのいくつかのアプリケーションでは、物体とカメラの間の距離を推定することが不可欠なタスクです。 このような画像のぼけを手がかりに処理を実現する手法の一つに、フォーカス/デフォーカスからの深度があります。 焦点/焦点ぼけからの深度には、通常、異なる焦点距離で撮影された同じシーンの画像のスタック、つまり「フォーカル スタック」として知られる技術が必要です。

過去 10 年ほどにわたって、科学者は焦点/焦点ぼけによる深度を求めるさまざまな方法を提案してきましたが、そのほとんどは 2 つのカテゴリに分類できます。 最初のカテゴリには、数学モデルと光学モデルを使用して、シャープネスまたはブラーに基づいてシーンの深度を推定するモデルベースの方法が含まれます。 しかし、このような方法の主な問題は、焦点スタック全体で実質的に同じに見えるテクスチャのない表面では失敗することです。

2 番目のカテゴリには、テクスチャのない表面であっても、フォーカス/デフォーカスからの深度を効率的に実行するようにトレーニングできる学習ベースの方法が含まれます。 ただし、入力焦点スタックに使用されるカメラ設定がトレーニング データセットで使用されるカメラ設定と異なる場合、これらのアプローチは失敗します。

現在、これらの制限を克服し、日本の研究者チームは、上記の問題に同時に対処する、焦点/焦点ぼけによる深度の革新的な方法を開発しました。 彼らの研究は、 出版された の中に コンピュータビジョンの国際ジャーナルは、奈良先端科学技術大学院大学(NAIST)の向川泰弘氏と藤村有紀氏が主導しました。

「フォーカルスタックからの深度」(DDFS)と呼ばれる提案された技術は、モデルベースの深度推定と学習フレームワークを組み合わせて、両方の長所を活用します。 ステレオ ビジョンで使用される戦略からインスピレーションを得た DDFS には、入力焦点スタック、カメラ設定、およびレンズの焦点ぼけモデルに基づいて「コスト ボリューム」を確立することが含まれます。

簡単に言えば、コスト ボリュームは、一連の深度仮説 (各ピクセルの潜在的な深度値) と、フォーカル スタック内の画像間の一貫性に基づいて計算された関連コスト値を表します。 「コスト ボリュームは、デフォーカス画像とシーンの深度の間に制約を課し、トレーニング時とテスト時に異なるカメラ設定での深度推定を可能にする中間表現として機能します」と向川氏は説明します。

DDFS 手法では、一般的に使用される機械学習アーキテクチャであるエンコーダ – デコーダ ネットワークも採用されています。 このネットワークは、画像内の局所的な構造を適応的に学習するために各段階で「コスト集計」を使用して、シーンの深度を粗いものから細かいものへと段階的に推定します。

研究者らは、DDFS のパフォーマンスを他の最先端のフォーカス/デフォーカス手法のパフォーマンスと比較しました。 特に、提案されたアプローチは、いくつかの画像データセットのさまざまな指標において、ほとんどの方法よりも優れたパフォーマンスを示しました。 研究チームのカメラで撮影した焦点スタックでの追加実験により、DDFS の可能性がさらに証明され、他の技術とは異なり、入力スタック内の入力画像が数枚しかない場合でも有用であることがわかりました。

全体として、DDFS は、ロボット工学、自動運転車、3D 画像再構築、仮想現実および拡張現実、監視など、深度推定が必要なアプリケーションにとって有望なアプローチとして機能する可能性があります。 「私たちの手法は、 カメラ「不変性の設定は、学習ベースの深度推定技術の適用可能性を拡張するのに役立ちます」と向川氏は結論づけています。

詳しくは:

藤村有紀他、カメラ設定の不変性のためのデフォーカスモデルを使用した焦点スタックからの深度、 コンピュータビジョンの国際ジャーナル (2023年)。 DOI: 10.1007/s11263-023-01964-x

によって提供された

奈良先端科学技術大学院大学

引用: フォーカス/デフォーカスからの深層イノベーションが、より高機能なコンピューター ビジョン システムへの道を開く (2024 年 2 月 9 日) https://techxplore.com/news/2024-02- Depth-focusdefocus-pave-capable- より 2024 年 2 月 10 日取得ビジョン.html

この文書は著作権の対象です。 個人的な研究や研究を目的とした公正な取引を除き、書面による許可なしにいかなる部分も複製することはできません。 コンテンツは情報提供のみを目的として提供されています。

#フォーカスデフォーカスに至るまでの徹底的なイノベーションによりより高性能なコンピューター #ビジョン #システムへの道が開かれます